Jak rozwija się technologia hostingu internetowego

Współczesny rynek usług hostingowych to dynamicznie zmieniający się obszar IT, w którym innowacje pojawiają się w szybkim tempie. Dzięki nieustannemu rozwojowi sprzętu oraz oprogramowania, operatorzy hostingowi są w stanie zaoferować klientom coraz wydajniejsze i bardziej elastyczne rozwiązania.

Artykuł przedstawia ewolucję tej branży, począwszy od pierwszych, prostych usług współdzielonego hostingu, aż po zaawansowane platformy chmurowe wyposażone w mechanizmy automatyzacji i skalowania. Analizie poddane zostaną kluczowe etapy rozwoju, które ukształtowały dzisiejszy krajobraz technologiczny.

W kolejnych sekcjach omówione zostaną zarówno historyczne uwarunkowania, jak i najnowsze trendy związane z bezpieczeństwem, niezawodnością oraz perspektywy dalszego wzrostu usług hostingowych. Dzięki temu zyskujemy pełny obraz możliwości, jakie niesie ze sobą nowoczesna technologia hostingu.

Początki hostingu internetowego

Początki hostingu sięgają lat 90. XX wieku, kiedy to sieć WWW zaczęła się gwałtownie rozwijać. Pierwsze usługi oparte były na serwerach fizycznych, dostępnych w ograniczonej liczbie centrów danych. Klienci wynajmowali wycinki zasobów, co oznaczało, że wiele stron internetowych współdzieliło ten sam sprzęt.

Takie rozwiązanie, określane dziś jako shared hosting, charakteryzowało się niską ceną, jednak niewielką elastycznością. Ograniczenia dotyczące wydajności, pamięci operacyjnej czy transferu danych sprawiały, że zaawansowane projekty i dużych firm nie były zadowolone z tego typu usług.

Wpływ rozwoju serwerów i infrastruktury sieciowej

Wraz z rozwojem sprzętu serwerowego, zaczęły pojawiać się serwery dedykowane, gdzie klienci mogli wynająć cały fizyczny węzeł w centrum danych. Pozwoliło to na pełną kontrolę nad konfiguracją, instalowanie dowolnego oprogramowania i lepsze dopasowanie zasobów do potrzeb aplikacji biznesowych.

Równolegle ewoluowała infrastruktura sieciowa – szybkie łącza światłowodowe, redundancja połączeń oraz zaawansowane systemy przełączające zwiększały niezawodność i zmniejszały opóźnienia w transmisji danych. hostido.pl udostępnia klientom pakiety, w których wydajne dyski SSD oraz gwarantowana przepustowość stanowią podstawę skalowalnych i pewnych środowisk hostingowych.

Dzięki wyższym prędkościom łączy oraz lepszym komponentom, wzrosła popularność platform opartych na protokołach HTTP/2 czy QUIC, co przyczyniło się do szybszego ładowania stron i aplikacji internetowych.

Rola wirtualizacji i chmury obliczeniowej

Pojawienie się wirtualizacji zrewolucjonizowało rynek hostingu. Technologia ta pozwoliła na tworzenie wielu maszyn wirtualnych (VM) na jednym fizycznym serwerze, dzięki czemu zasoby mogły być efektywniej wykorzystane.

Z kolei chmura obliczeniowa wprowadziła model płatności „pay-as-you-go” i automatyczne skalowanie, co daje klientom możliwość dynamicznego dostosowywania mocy obliczeniowej do aktualnych potrzeb. W ten sposób osiągany jest optymalny balans między kosztami a wydajnością.

Do najważniejszych korzyści zaliczyć można między innymi:

- elastyczne przydzielanie zasobów w czasie rzeczywistym,

- izolację środowisk dzięki konteneryzacji,

- łatwe wdrażanie kopii zapasowych i migrację pomiędzy serwerami.

Znaczenie automatyzacji i zarządzania zasobami

Automatyzacja procesów administracyjnych stała się nieodzownym elementem nowoczesnych usług hostingowych. Dzięki narzędziom do zarządzania konfiguracją, takim jak Ansible czy Puppet, możliwe jest masowe wdrażanie i aktualizowanie serwerów bez konieczności ręcznego ingerowania w każdy węzeł.

W efekcie operatorzy mogą kontrolować i monitorować setki, a nawet tysiące maszyn z jednego panelu zarządzania, co znacząco obniża ryzyko błędów ludzkich i skraca czas reakcji na incydenty. Scentralizowane systemy monitoringu oraz mechanizmy alertów pozwalają na wczesne wykrywanie anomalii.

Trendy w bezpieczeństwie i niezawodności usług

Bezpieczeństwo to obecnie jeden z kluczowych czynników decydujących o wyborze oferty hostingowej. Współcześni dostawcy stawiają na zaawansowane mechanizmy ochronne, takie jak certyfikaty SSL, zapory sieciowe nowej generacji czy systemy wykrywania nieautoryzowanych prób dostępu.

Równie istotne stają się rozwiązania zapewniające redundancję – wielokrotne kopie danych, niezależne zasilanie czy redundantne łącza internetowe to standard w profesjonalnych centrach danych. Dzięki temu ryzyko przestojów jest minimalizowane, co jest niezbędne np. w serwisach e-commerce czy aplikacjach biznesowych.

Przyszłość technologii hostingu internetowego

Patrząc w przyszłość, można spodziewać się dalszej integracji rozwiązań serverless, czyli środowisk, w których programista nie musi zajmować się serwerami, a jedynie wdraża kod. Generatywne systemy sztucznej inteligencji będą automatycznie optymalizować konfiguracje pod kątem wydajności i kosztów.

Równie ważny kierunek to dalszy rozwój edge computingu – rozproszonej obliczeniowej sieci, która umieszcza zasoby coraz bliżej użytkowników końcowych, redukując opóźnienia i poprawiając jakość dostarczanych usług.

Ostatnie Artykuły

Rycerz rozbił Victorię po przerwie. W Niemstowie padło dziesięć goli

Autobusy pojadą inaczej. W gminie Lubin ruszy nowa linia

Wodociąg na granicy wydolności. Apel do sześciu miejscowości pod Lubinem

![[PIŁKA NOŻNA] Jagiellonia Białystok – KGHM Zagłębie Lubin 1:0 w PKO BP Ekstraklasie](/images/mecz/thumbnails/jagiellonia-bialystok-kghm-zaglebie-lubin-23052026-10.webp)

[PIŁKA NOŻNA] Jagiellonia Białystok – KGHM Zagłębie Lubin 1:0 w PKO BP Ekstraklasie

Rowy melioracyjne pod lupą. W Lubinie obowiązek zaczyna się na prywatnych działkach

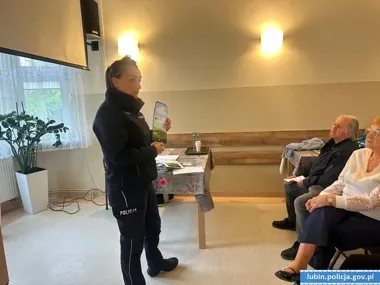

W Lubinie seniorzy usłyszeli, jak działają oszuści na wnuczka i na policjanta

W Raszówce zabrzmi muzyka na Dzień Mamy. Na scenie wystąpią dzieci i Leśne Echo

![[PIŁKA NOŻNA] Betclic 3. Liga Grupa 3 (Grupa III) – KGHM Zagłębie Lubin II – Miedź Legnica II 1:3](/images/mecz/thumbnails/kghm-zaglebie-lubin-ii-miedz-legnica-ii-22052026-13.webp)

[PIŁKA NOŻNA] Betclic 3. Liga Grupa 3 (Grupa III) – KGHM Zagłębie Lubin II – Miedź Legnica II 1:3

Bieg przez dmuchane przeszkody zadebiutuje w Lublinie. Jest tylko 500 miejsc

Zlekceważył zakaz zbliżania się do matki - skończył w areszcie

Rodzinne atrakcje w Gorzycy. Tor przeszkód i rajd rowerowy dla dzieci i dorosłych

Z Niemstowa do Warszawy. Trzy dni, które połączyły historię, naukę i wielki stadion

Jedno koło i koniec jazdy - motocyklista z Wrocławia stracił prawo jazdy w Lubinie

Grogu wraca do Muzy - Lubin dostaje kosmiczną premierę

Przydatne dane teleadresowe

- Urząd Miejski w Lubinie - kontakt, wydziały, godziny i sprawy do załatwienia

- Ogród Zoologiczny w Lubinie - godziny, cennik, dojazd i atrakcje

- Przychodnia w Ścinawie - kontakt, rejestracja, poradnie i godziny

- Muzeum Historyczne w Lubinie - bilety, godziny, wystawy i dojazd

- Zakład Gospodarki Komunalnej w Ścinawie - kontakt, awarie, BOK i PSZOK

- Urząd Miasta i Gminy Ścinawa - kontakt, godziny, wydziały i sprawy online